🌐 从 OpenAI 兼容服务器开始

概述

Open WebUI 不仅适用于 OpenAI/Ollama/Llama.cpp——您可以连接任何实现 OpenAI 兼容 API 的服务器,无论是在本地还是远程运行。如果您想运行不同的语言模型,或者您已经有自己喜欢的后端或生态系统,这将是完美的。本指南将向您展示如何

- 设置一个 OpenAI 兼容服务器(包含一些流行选项)

- 将其连接到 Open WebUI

- 立即开始聊天

步骤 1:选择一个 OpenAI 兼容服务器

有许多服务器和工具都公开了 OpenAI 兼容的 API。以下是一些最受欢迎的:

- Llama.cpp:极其高效,可在 CPU 和 GPU 上运行

- Ollama:超级用户友好且跨平台

- LM Studio:适用于 Windows/Mac/Linux 的丰富桌面应用程序

- Lemonade:基于 ONNX 的快速后端,支持 NPU/iGPU 加速

选择最适合您工作流程的!

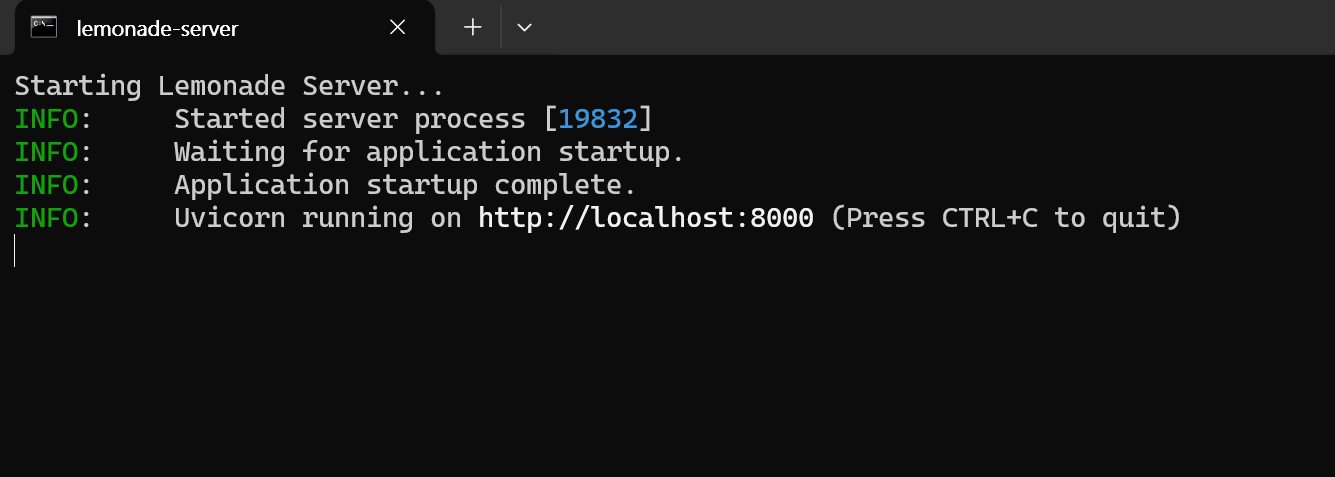

🍋 Lemonade 入门

Lemonade 是一个即插即用的基于 ONNX 的 OpenAI 兼容服务器。以下是如何在 Windows 上尝试它:

-

运行

Lemonade_Server_Installer.exe -

使用 Lemonade 的安装程序安装和下载模型

-

运行后,您的 API 端点将是

https://:8000/api/v0

有关详细信息,请参阅他们的文档。

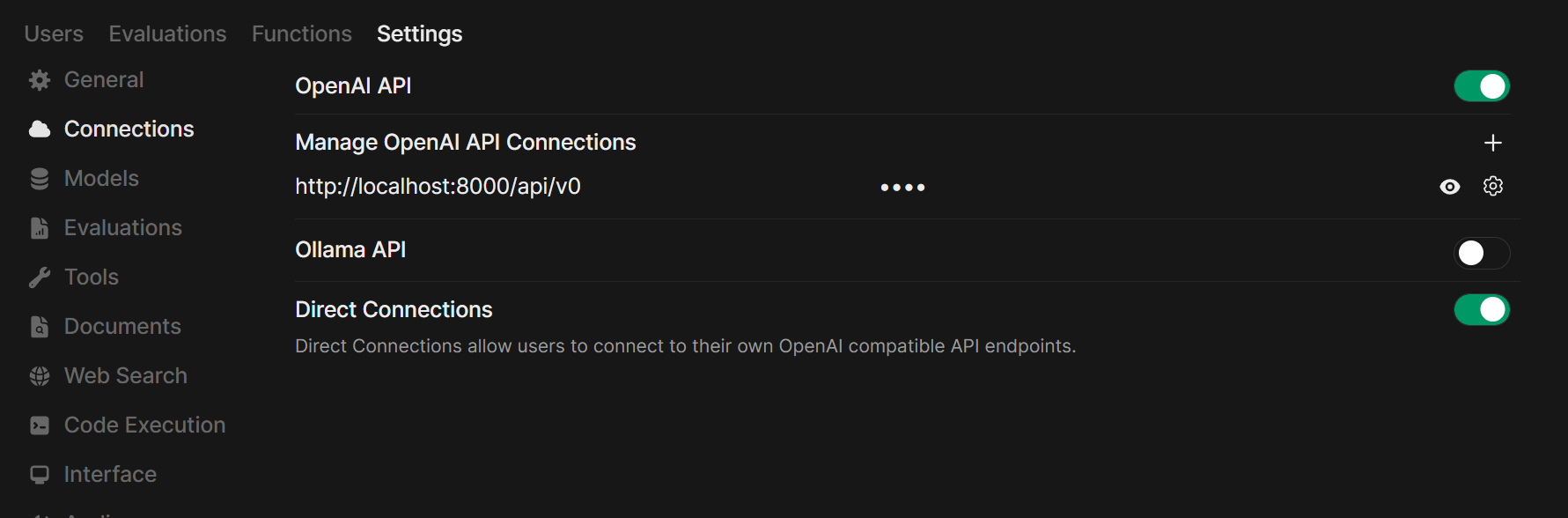

步骤 2:将您的服务器连接到 Open WebUI

-

在您的浏览器中打开 Open WebUI。

-

前往 ⚙️ 管理设置 → 连接 → OpenAI 连接。

-

点击 ➕ 添加连接。

- URL:使用您服务器的 API 端点(例如,Ollama 的

https://:11434/v1,或您自己的 Llama.cpp 服务器地址)。 - API 密钥:除非需要,否则留空。

- URL:使用您服务器的 API 端点(例如,Ollama 的

-

点击保存。

提示:如果您在 Docker 中运行 Open WebUI,并且模型服务器运行在您的主机上,请使用 http://host.docker.internal:<your-port>/v1。

对于 Lemonade: 添加 Lemonade 时,请使用 https://:8000/api/v0 作为 URL。

步骤 3:开始聊天!

在聊天菜单中选择您已连接服务器的模型,然后开始吧!

就是这样!无论您选择 Llama.cpp、Ollama、LM Studio 还是 Lemonade,您都可以在 Open WebUI 中轻松试验和管理多个模型服务器。

🚀 享受构建您完美的本地 AI 设置!